Die zunehmende Nutzung von Rezyklaten verändert die Materialentwicklung grundlegend. Während Primärrohstoffe in der Regel eine gleichbleibende chemische Zusammensetzung und klar definierte physikalische Eigenschaften aufweisen, bringen Rezyklate eine neue Realität in F&E: Variabilität auf mehreren Ebenen.

Diese Variabilität zeigt sich nicht nur zwischen unterschiedlichen Lieferungen, sondern oft auch innerhalb einer einzelnen Charge. Für Entwicklungsteams bedeutet das: Annahmen, die früher als verlässlich galten, müssen heute kontinuierlich überprüft werden.

Die zentrale Frage lautet daher: Wie lassen sich unter diesen Bedingungen reproduzierbare Ergebnisse und fundierte Entscheidungen sicherstellen?

Die Antwort liegt nicht primär in zusätzlichen Experimenten, sondern in der Fähigkeit, strukturierte Daten systematisch zu erfassen, zu verknüpfen und auszuwerten.

Wenn Variabilität auf klassische Rezepturentwicklung trifft

Die Rezepturentwicklung polymerbasierter Materialien basiert häufig auf iterativen Zyklen: Formulierung anpassen, testen, Ergebnisse bewerten. Dieses Vorgehen ist effizient, solange die Qualität der Ausgangsmaterialien konsistent ist.

Mit Rezyklaten steigt jedoch die Zahl relevanter Einflussfaktoren erheblich. Typische Variationen betreffen:

- Molekulargewichtsverteilung (z. B. durch Kettenabbau oder -verlängerung infolge thermischer und mechanischer Belastung im Recyclingprozess)

- Restadditive aus vorherigen Anwendungen (z. B. Stabilisatoren, Weichmacher, Flammschutzmittel)

- Fremdpolymere (Kompatibilitäts- und Phasentrennungsprobleme)

- Verunreinigungen (wie Farbpigmente, Metalle oder Schmutz)

- thermische und mechanische Alterung (z. B. Oxidation, Hydrolyse)

Diese Faktoren wirken sich direkt auf:

- rheologische Eigenschaften (z. B. Viskosität, Fließverhalten)

- thermische Eigenschaften (z. B. Glasübergang, Schmelzverhalten)

- mechanische Performance und Verarbeitbarkeit

- optische Eigenschaften (z. B. Farbe und Transparenz)

aus.

Praxisbeispiel:

Ein Compounder ersetzt einen Neuware-Polymeranteil durch ein Rezyklat. Im Labormaßstab zeigt sich eine erhöhte Viskosität in der Verarbeitung. Eine erste Hypothese: veränderte Molekulargewichtsverteilung, wobei auch Restadditive oder Fremdpolymere mit höherem Molekulargewicht als Ursache in Betracht kommen.

Allerdings liegen keine vergleichbaren historischen Messdaten vor, die diese Annahme bestätigen oder widerlegen könnten. Gleichzeitig sind relevante Prozessparameter aus früheren Versuchen nicht eindeutig dokumentiert.

Das Team reagiert mit der Durchführung neuer Versuchsreihen, weil die benötigten Informationen im Unternehmen zwar existieren, aber nicht zugänglich oder verknüpft sind.

Das eigentliche Problem: Fehlende Datenintegration

In vielen Organisationen existieren große Mengen an Daten aus:

- Materialcharakterisierung

- Prozessentwicklung

- Anwendungstests

- Qualitätssicherung

Das Problem liegt selten in der Datenmenge, sondern in deren Struktur:

- Messdaten aus FTIR-Spektroskopie oder Rheometrie werden getrennt gespeichert

- Formulierungen liegen in Excel-Tabellen oder Laborbüchern

- Prozessparameter sind in Maschinensystemen oder separaten Tools dokumentiert

Diese Fragmentierung verhindert, dass Zusammenhänge erkannt werden.

Konkretes Szenario:

Ein Team analysiert zwei Rezyklatchargen mit FTIR. Die Spektren zeigen Unterschiede in bestimmten funktionellen Gruppen. Parallel dazu wurden rheologische Messungen durchgeführt, die eine Abweichung im Fließverhalten zeigen.

Ohne verknüpfte Datenstrukturen bleibt unklar:

- Welche Formulierung wurde exakt verwendet?

- Welche Prozessbedingungen lagen vor?

- Besteht eine Korrelation zwischen Spektren und rheologischen Eigenschaften?

Die Daten existieren, können aber nicht zur Entscheidungsfindung genutzt werden.

Versuchsplanung wird erst durch Daten nutzbar

Eine strukturierte Versuchsplanung (Design of Experiments, DoE) ist ein bewährter Ansatz, um komplexe Systeme effizient zu untersuchen. Sie hilft, Einflussfaktoren gezielt zu variieren und Wechselwirkungen sichtbar zu machen.

Doch auch hier gilt: Der Wert einer Versuchsreihe hängt nicht nur von ihrem Design ab, sondern auch davon, wie ihre Ergebnisse später genutzt werden können.

Materialcharakterisierung als vernetzter Prozess

Die Materialcharakterisierung liefert zentrale Informationen über Materialsysteme:

- FTIR-Spektroskopie → chemische Struktur

- Rheometrie → Fließverhalten und rheologische Eigenschaften

- DSC → thermische Eigenschaften

- GPC → Molekulargewichtsverteilung

Diese Methoden sind etabliert. Ihr volles Potenzial wird jedoch oft nicht ausgeschöpft, da die erzeugten Messdaten nicht systematisch mit:

- Formulierungsvarianten

- Prozessparametern

- Anwendungsergebnissen

verknüpft werden.

Beispiel:

Zwei Materialien zeigen identische FTIR-Spektren, aber unterschiedliche Verarbeitungseigenschaften. Erst durch die Verknüpfung mit Prozessdaten wird sichtbar: Die Unterschiede entstehen durch unterschiedliche Scherhistorien im Prozess.

Ohne integrierte Daten bleibt dieser Zusammenhang verborgen. Dies verdeutlicht, dass es nicht nur um Datenerfassung geht, sondern um deren systematische Verknüpfung. Hier setzt das Konzept der Material Intelligence an.

Gemeint ist ein Ansatz, bei dem Daten aus Materialcharakterisierung, Rezepturentwicklung und Prozessparametern in gemeinsamen Datenstrukturen zusammengeführt werden, um Zusammenhänge nachvollziehbar und nutzbar zu machen. Ziel ist es, Materialverhalten im Kontext aller relevanten Einflussfaktoren zu betrachten und als Grundlage für datenbasierte Entscheidungen zu nutzen.

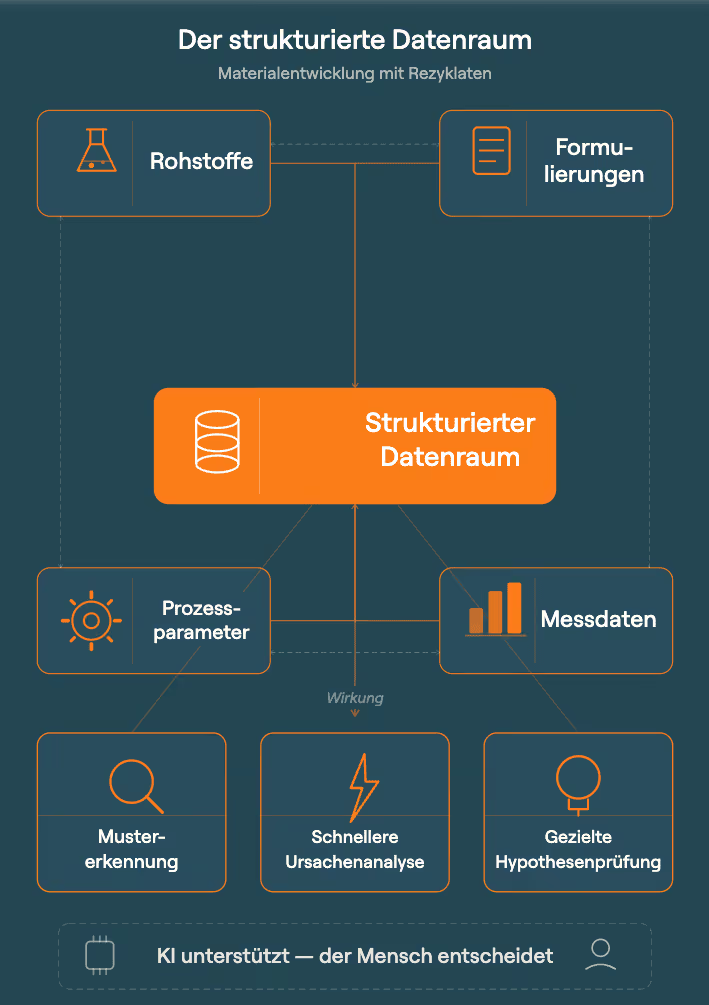

Von fragmentierten Daten zu strukturierten Datenräumen

Um diese Komplexität beherrschbar zu machen, braucht es mehr als Datenspeicherung. Es braucht strukturierte Datenräume, in denen Informationen in Beziehung gesetzt werden.

Ein solcher Datenraum verbindet:

- Rohstoffe und ihre chemische Zusammensetzung

- Formulierungen aus der Rezepturentwicklung

- Prozessparameter aus der Verarbeitung

- Messdaten aus der Materialcharakterisierung

Innerhalb dieser Struktur wird Musterkennung möglich.

Das bedeutet konkret:

- Wiederkehrende Zusammenhänge werden sichtbar

- Abweichungen lassen sich schneller erklären

- Hypothesen können gezielter getestet werden

Wichtig: KI-Methoden unterstützen diese Musterkennung, ersetzen aber keine wissenschaftliche Bewertung. Entscheidungen bleiben beim F&E-Team.

Was in der Praxis den Unterschied macht

Der Aufbau solcher Datenräume erfordert keine perfekte Lösung von Anfang an, sondern konsistente Prinzipien:

- Einheitliche Datenstrukturen für Materialien, Versuche und Ergebnisse

- Direkte Verknüpfung von Messdaten, Formulierungen und Prozessparametern

- Nachvollziehbare Historie in der Rezepturentwicklung

- Systeme, die sich in bestehende Workflows integrieren

Praxisbeispiel:

Ein Unternehmen führt eine zentrale Datenbasis ein, in der jede Formulierung automatisch mit zugehörigen Messdaten und Prozessparametern verknüpft wird.

Nach wenigen Monaten zeigt sich:

- Die Anzahl unnötiger Experimente nimmt ab

- Abweichungen lassen sich schneller erklären

- Neue Materialien können gezielter entwickelt werden

Regulatorik verstärkt die Anforderungen

Externe Anforderungen wie REACH oder der digitale Produktpass erhöhen den Druck, Materialdaten nachvollziehbar zu dokumentieren.

Das betrifft insbesondere:

- Herkunft und Zusammensetzung von Materialien

- Verarbeitungsschritte

- Nachweise über Materialeigenschaften

Unternehmen mit integrierten Datenräumen sind hier im Vorteil, da relevante Informationen bereits strukturiert vorliegen.

Von reaktiver zu prädiktiver Entwicklung

Mit zunehmender Datenqualität verändert sich die Rolle von F&E grundlegend.

Statt ausschließlich reaktiv zu arbeiten, können Teams zunehmend:

- Materialverhalten auf Basis bestehender Daten einschätzen

- gezielt Hypothesen formulieren

- Experimente effizienter planen

Beispiel: Basierend auf historischen Daten erkennt ein Team, dass bestimmte Kombinationen aus Molekulargewichtsverteilung und Additivgehalt zu instabilen rheologischen Eigenschaften führen.

Neue Formulierungen können dadurch gezielt angepasst werden, bevor umfangreiche Labortests notwendig sind.

Fazit

Die Nutzung von Rezyklaten macht sichtbar, was für die Materialentwicklung generell gilt: Erkenntnis entsteht nicht durch Daten allein, sondern durch deren Struktur und Verknüpfung.

Strukturierte Daten, konsistente Datenintegration und vernetzte Datenräume schaffen die Grundlage für:

- reproduzierbare und nachvollziehbare Entwicklungsprozesse

- fundierte Entscheidungen

- effiziente Nutzung vorhandener Informationen

Material Intelligence beschreibt in diesem Kontext die Fähigkeit, Daten, Workflows und KI so zu verbinden, dass Materialverhalten nicht isoliert betrachtet wird, sondern im Gesamtzusammenhang verstanden und für fundierte Entscheidungen nutzbar wird.